近年来,改进的人工智能 (AI) 算法和对训练数据的访问导致人工智能增强或取代医生当前的一些功能的可能性。 然而,各利益相关者对在医学中使用人工智能的兴趣并未转化为广泛采用。 正如许多专家所说,这种限制采用的主要原因之一是与特定 AI 算法,尤其是黑盒算法相关的缺乏透明度。 临床医学,主要是循证医学实践,依赖于决策的透明度。如果没有医学上可解释的人工智能,并且医生无法合理地解释决策过程,那么患者对他们的信任就会受到侵蚀。为了解决某些 AI 模型的透明度问题,出现了可解释的 AI。

在《柳叶刀数字健康》中,Marzyeh Ghassemi 及其同事 认为,目前可用的可解释 AI 应用程序并不完善,只能部分解释 AI 算法的内部工作原理。他们呼吁利益相关者放弃对可解释性的坚持,并寻求其他措施,如验证,以增强对黑盒模型的信任和信心。他们对某些可解释框架的批评是有道理的,比如事后解释器。这些解释器大多近似于底层机器学习机制来解释决策。然而,基于某些可解释 AI 方法的局限性,限制可解释 AI 并优先考虑其他验证方法(如随机对照试验)的论点是似是而非的。

无法很好解释决策的模型或系统可能难以接受,尤其是在医学等领域。依赖黑盒模型的逻辑违反了医学伦理。黑盒医疗实践阻碍了临床医生评估模型输入和参数的质量。如果临床医生无法理解决策制定,他们可能侵犯了患者知情同意权和自主权。当临床医生无法解读结果是如何得出时,他们就不太可能与患者沟通和披露适当地,从而影响患者的自主权和参与知情同意的能力。越来越多的高性能黑盒模型被捕获使用错误或混淆变量来实现其结果的例子。例如,深度学习模型发现哮喘患者死于肺炎的风险较低,因为该模型从训练数据集中学习,该数据集包括一组接受临床医生积极干预的哮喘患者。在另一个示例中,一种用于筛查肺炎 X 光片的深度学习模型使用诸如扫描仪位置之类的混杂信息来检测肺炎。 在第三个示例中,一种用于区分高风险患者和低风险患者的深度学习模型,基于射线,使用与硬件相关的元数据来预测风险。这些案例表明,对模型准确性的依赖是不够的。需要额外的信任增强框架,例如可解释的 AI。

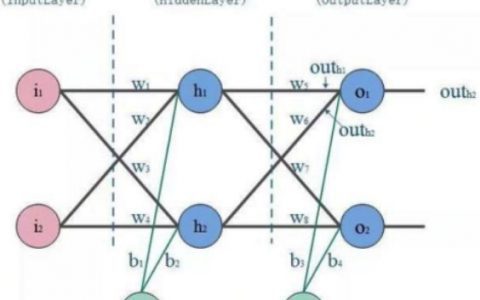

尽管近年来对可解释 AI 方法的批评越来越多,但对于导致需要可解释 AI 的原因(深度学习模型)的审查似乎很少。这样的模型没有明确的陈述性知识表示,这对推导解释性叙述提出了挑战。许多高性能深度学习模型具有数百万甚至数十亿个参数,这些参数只能通过它们在复杂网络中的位置来识别,而不是作为人类可解释的标签,从而导致黑盒情况。此外,许多在训练数据集在独立数据集上表现不佳。此外,深度学习算法需要对大量数据进行插值和外推训练。深度学习模型的这些问题尚未得到有意义的解决,并在包括医学在内的各种应用中持续存在。

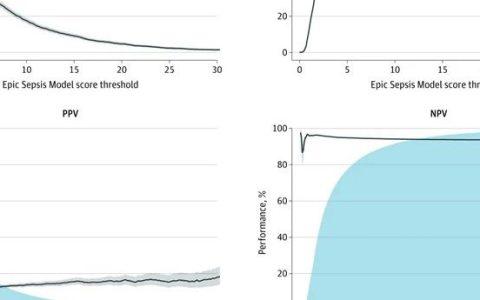

可解释 AI 的批评者认为有效性度量的优先级高于可解释性框架。 理由是,目前,许多药物和医疗设备采用验证过程(例如随机对照试验)来表明疗效,支持人工智能的医疗设备或软件也应如此。但是,我们认为这种说法是不恰当的。通常,AI 系统的性能是根据预测准确度度量来评估的。即使尽最大努力,由于误差来源不同,AI 系统也不太可能达到完美的准确度。如果理论上达到了完美的准确度,并不能保证人工智能系统仍然没有偏见—尤其是当系统已经接受过异构和复杂数据的训练时,就像医学中发生的那样。

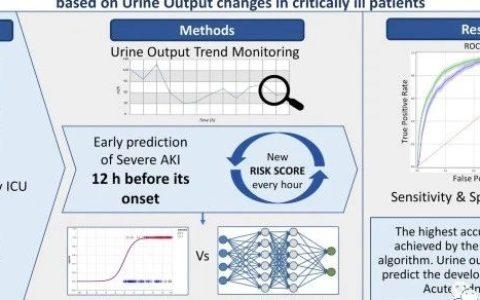

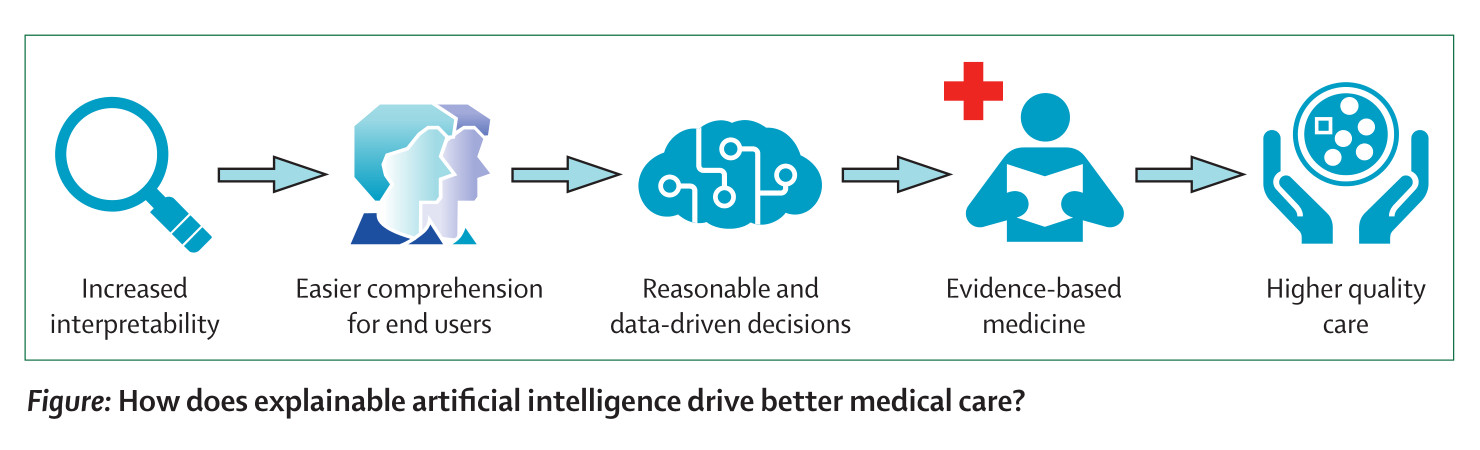

忽略或限制可解释的人工智能不利于人工智能在医学中的应用,因为很少有替代方案能够全面应对问责制、信任和监管问题,同时增强人工智能技术的信心和透明度。使用可解释的框架有助于使模型性能与临床指南目标保持一致。因此,可以在临床实践中更好地采用 AI 模型。透明的算法或解释性方法还可以降低临床从业者采用 AI 系统的风险。 已经有越来越多的例子说明各种医学专业的可解释框架如何提高透明度和洞察力。 这些案例研究可以指导可解释的人工智能与人工智能医疗系统的集成。通过这种整合,可以实现第二层次的可解释性和多种好处,包括更高的可解释性、更好地理解临床医生从而导致循证实践以及改善临床结果

本文荟萃自,只做学术交流学习使用,不做为临床指导,本文观点不代表数字重症 ICU.CN立场。

微信扫一扫

微信扫一扫